Tout comprendre des capteurs de vos appareils photo et smartphones - Android

De tous les composants d'un appareil photographique, le capteur photo est sans conteste celui qui semble le plus magique. Mais, n'en déplaise aux envolées lyriques des services marketing, avoir le plus grand, le plus défini, le plus sensible, le plus tout est-il toujours bénéfique ? Pour bien choisir, le mieux reste de bien comprendre, et ce dossier va vous y aider.

Le reflet rose visible sur le capteur est causé par la présence d’un filtre infrarouge // crédit : Bruno Labarbère

Cela ne vous aura pas échappé : que ce soit pour un smartphone ou un appareil photographique numérique (APN), le premier réflexe est d’aller vérifier les caractéristiques du capteur photo qui l’anime. La plupart du temps le marketing s’en charge pour vous. Plus grand, plus rapide, plus fort : le bonheur photographique pour une poignée de mégapixels en plus ! Un discours des gros nombres qui tente souvent de se soustraire aux réalités techniques, le mieux n’étant pas forcément l’ami du bien. Alors, pour ne pas vous laisser embobiner, un petit tour d’horizon de l’état de l’art s’imposait.

Le capteur photo, un organe sensible

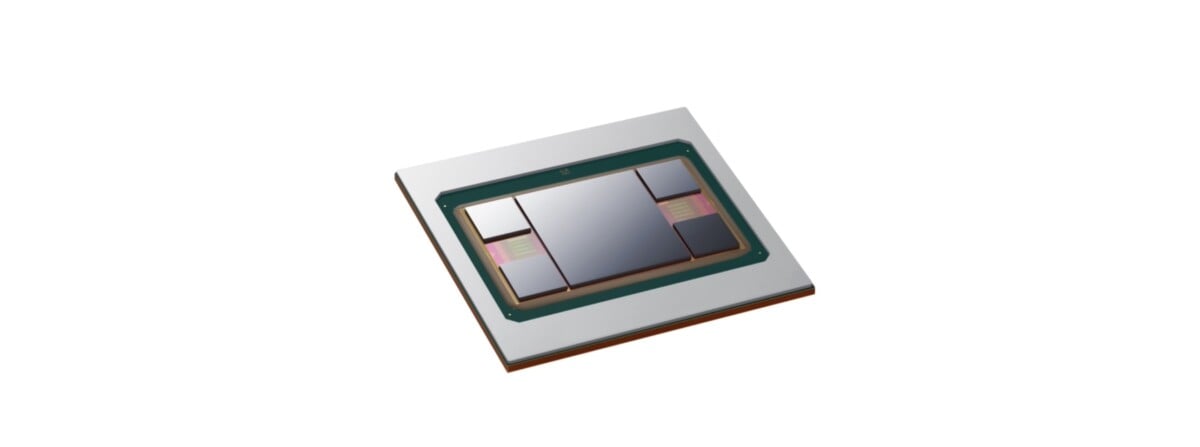

Le capteur photo est un composant électronique à base de silicium, de cuivre et de verre chargé de collecter la lumière issue de l’objectif et de la convertir en information électrique. Dans la chaîne de production de l’image, c’est ensuite au processeur de traitement d’image de convertir ce signal analogique en information numérique (avec des 0 et des 1). Pour collecter la lumière, le capteur est divisé en de multiples petits puits de lumière, appelés photosites, généralement carrés, dont la taille est exprimée en microns (µm) voire en nanomètres (nm). L’information issue de chaque photosite individuel devient, après passage à la moulinette du processeur, un pixel (picture element) constitutif de l’image. La bonne délimitation des photosites fait l’objet de nombreuses innovations, comme le montre notamment Samsung et ses capteurs Isocell passés en génération 2.0 début 2021.

Tout comme l’halogénure d’argent contenu dans les pellicules, le silicium du capteur photo est capable de réagir à la lumière. On dit alors d’eux qu’ils sont photosensibles. Là où une réaction chimique se produit en argentique pour former une image, c’est la propriété du silicium de produire un signal électrique lorsqu’il est soumis à la lumière qui est exploitée dans nos capteurs d’APN et de smartphones. Notez que des recherches sont en cours pour développer des capteurs photo dont le substrat ne serait plus des atomes de silicium (Si), mais des atomes de la chimie organique (carbone C, azote N, hydrogène H, oxygène O), d’où le nom de « capteurs organiques ». Ceux-ci devraient arriver sur le marché d’ici quelques années.

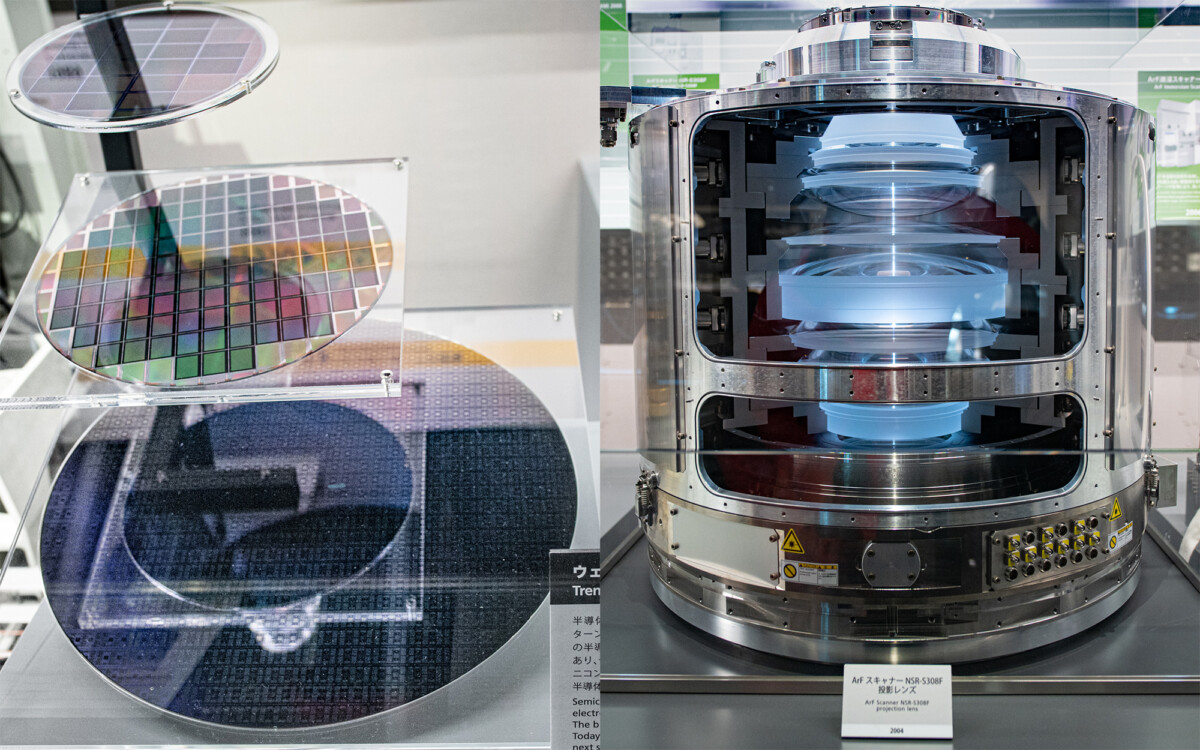

À gauche des wafers de silicium (ronds) dans lesquels sont gravés puis taillés les capteurs (rectangulaires). La perte périphérique est bien visible sur le wafer du milieu.

À droite, un objectif spécialisé permettant la gravure des capteurs. (L’objectif fait 150 cm de haut !)

Pour transporter l’électricité en dehors du capteur de l’appareil photo et lui permettre de communiquer avec les autres composants, il est doté de pistes électroniques, généralement en cuivre, plus rarement en argent, or ou aluminium. Enfin, tout ce beau monde est recouvert par de multiples couches de verre aux rôles bien distincts. De l’extérieur vers l’intérieur :

- La première a une fonction de barrière physique protectrice, contre les poussières, les projections de lubrifiant, les gouttelettes d’eau (et de salive, mais vous n’êtes pas censés cracher sur vos capteurs).

- La deuxième couche a pour mission de filtrer les rayons infrarouges (IR) à cause desquels vos images pourraient prendre une teinte violette désagréable. Certains photographes choisissent cependant de supprimer ce filtre IR pour, justement, s’adonner aux joies de la photographie infrarouge comme au temps de l’argentique où on utilisait des pellicules dédiées. Il va sans dire que la garantie saute en même temps que le filtre IR.

- La troisième couche dite « filtre passe-bas » ou « filtre anti-aliasing » permet d’ajouter du flou pour minimiser l’artefact d’aliasing, ou crénelage en bon français. Ce filtre a tendance à disparaître sur les capteurs récents à très haute définition.

- La quatrième couche est généralement un réseau de micro-lentilles qui permet d’orienter correctement les rayons de lumière vers les photosites (et pas entre les deux). Au centre du capteur photo, ces rayons incidents sont presque perpendiculaires au capteur, puis ils deviennent de plus en plus inclinés au fur et à mesure que l’on se rapproche de la périphérie, compliquant le travail des micro-lentilles et donc leur conception. Cela est d’autant plus vrai sur les appareils photo hybrides que sur les reflex, puisque l’arrière de l’objectif est deux fois plus proche du capteur.

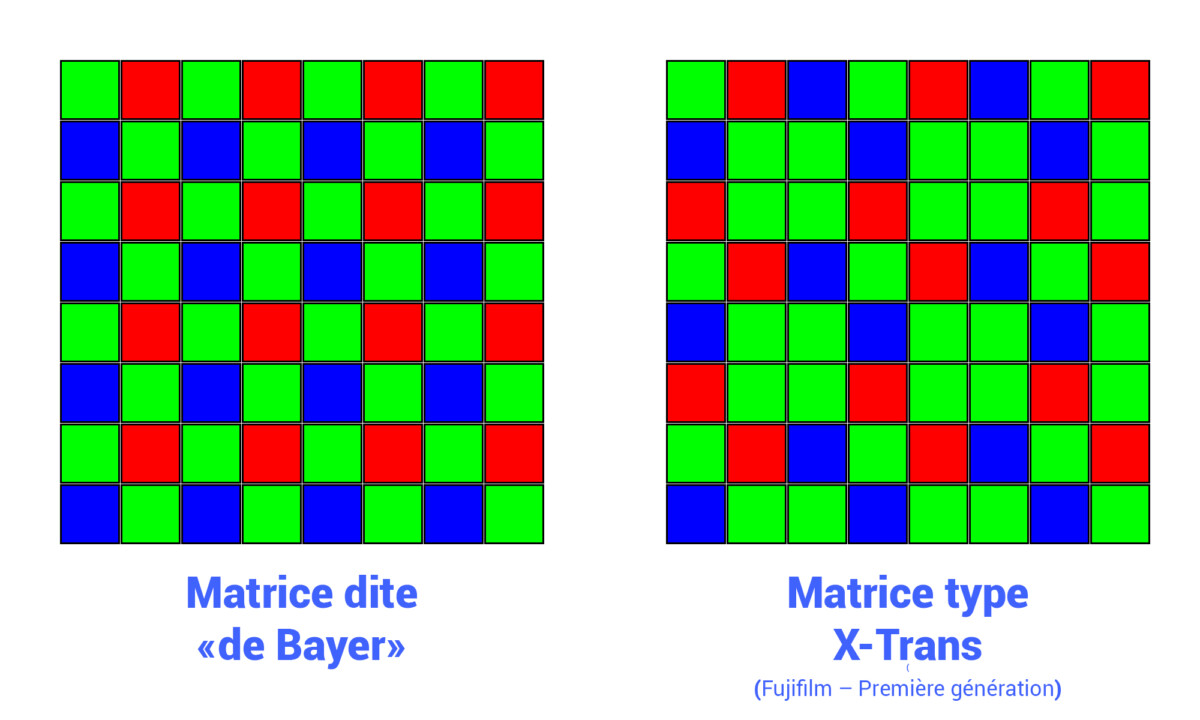

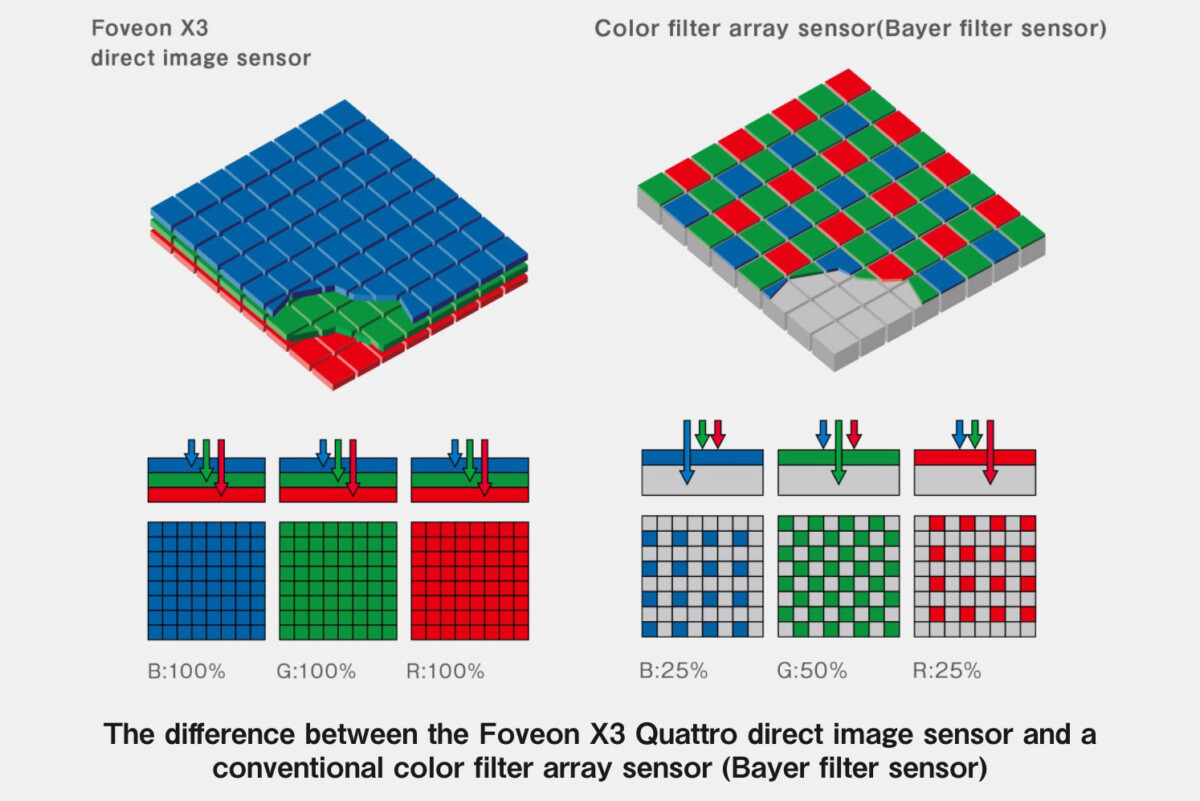

- Cinquième et ultime couche : les filtres colorés. Ceux-ci peuvent être de l’une des trois couleurs primaires de la lumière : rouge, vert ou bleu. Ils permettent à chaque photosite de ne capter qu’une seule couleur à la fois, le processeur se chargeant ensuite de reconstituer les deux informations chromatiques manquantes à partir de celles des photosites adjacents (avec parfois quelques erreurs d’estimation). Ce damier coloré forme une matrice qui peut soit être dite de type Bayer (du nom de son inventeur) dans l’écrasante majorité des cas, soit de type X-Trans (exclusif à Fujifilm), soit un dérivé de la matrice de Bayer (généralement par adjonction de filtres blancs, ou jaunes, ou magenta, ce qui arrive dans certains smartphones). Il peut aussi ne pas du tout y avoir de filtre coloré dans le cas d’un capteur monochrome capable de photographier uniquement en noir et blanc. Cas le plus rare, et exclusif aux APN Sigma, les capteurs Foveon se dispensent de filtre coloré. La séparation des couleurs selon leur longueur d’onde se fait alors dans la profondeur du photosite, exploitant pour cela une propriété quantique du silicium (une histoire de potentiel énergie et d’électronvolt).

- Ces dernières années, avec l’avènement des hybrides, vous croiserez de plus en plus souvent des capteurs photo dont certains photosites sont dédiés à la gestion de l’autofocus, mais cela ne change rien à l’architecture de base.

Source : Sigma Global

Jusqu’à nouvel ordre — comprendre « jusqu’à la prochaine révolution technologique » –, cette architecture de base et le fonctionnement qu’elle implique sont communs à tous les capteurs dédiés à la photographie et la vidéo numérique, qu’il s’agisse d’un capteur pour smartphone, pour appareil photo, pour webcam, pour drone, pour caméra de surveillance ou pour satellite d’espionnage militaire. La variété des capteurs que vous rencontrerez se situe donc ailleurs. Qu’est-ce qui les différencie alors ? Nous allons le voir tout de suite.

Les différents types de capteurs photo

À partir de cette architecture commune, divers types de capteurs cohabitent dans nos APN et smartphones et cela est emmené à évoluer au gré des innovations technologiques.

Le CCD est mort, longue vie au CMOS

Les capteurs CCD (Charged-Couple Device) ont été les premiers développés. Réputés produire des couleurs très intenses, vibrantes et fidèles, ils ont néanmoins complètement disparu de la circulation et ont été supplantés par les capteurs CMOS (Complementary Metal-Oxyd Semiconductor). Ceux-ci ont su tirer leur épingle du jeu grâce à leur plus faible consommation électrique, ce qui a permis de les implanter dans des appareils nomades, de plus en plus compacts. Peu à peu, les capteurs photo CMOS sont parvenus à égaler puis dépasser la qualité d’image des CCD, même si ceux-ci conservent leurs aficionados.

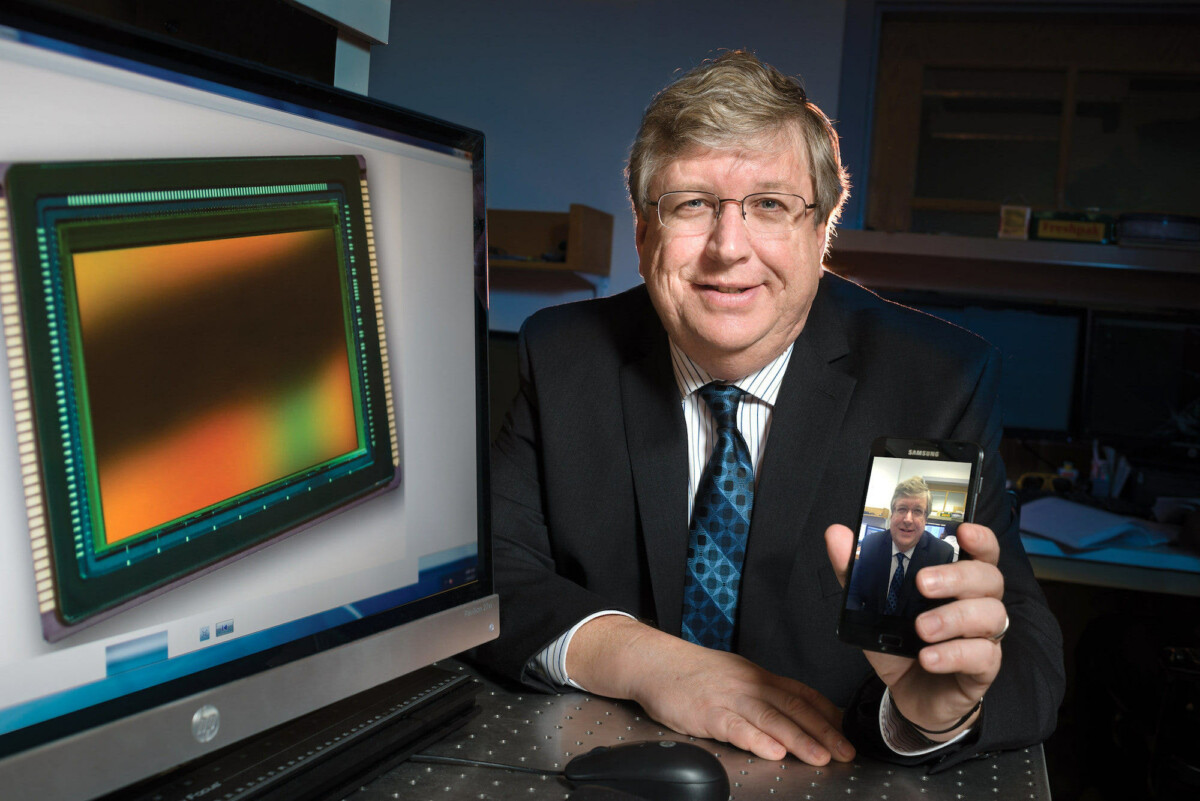

Portrait d’Eric Fossum, co-inventeur de la technologie de capteurs CMOS avec le Jet Propulsion Laboratory (qu’il dirigeait) et Caltech University. Source : Darthmouth Engineering Thayer School

Pour la petite histoire, les capteurs CMOS ont été initialement développés par le JPL (Jet Propulsion Laboratory) et l’Université Caltech pour équiper les satellites de la NASA. En sachant que sans la technologie CMOS, nos smartphones devraient se passer de module photographique basse consommation, il est donc légitime d’écrire que sans conquête spatiale, pas de selfies !

BSI CMOS ou FSI CMOS, quelle différence pour quel bénéfice ?

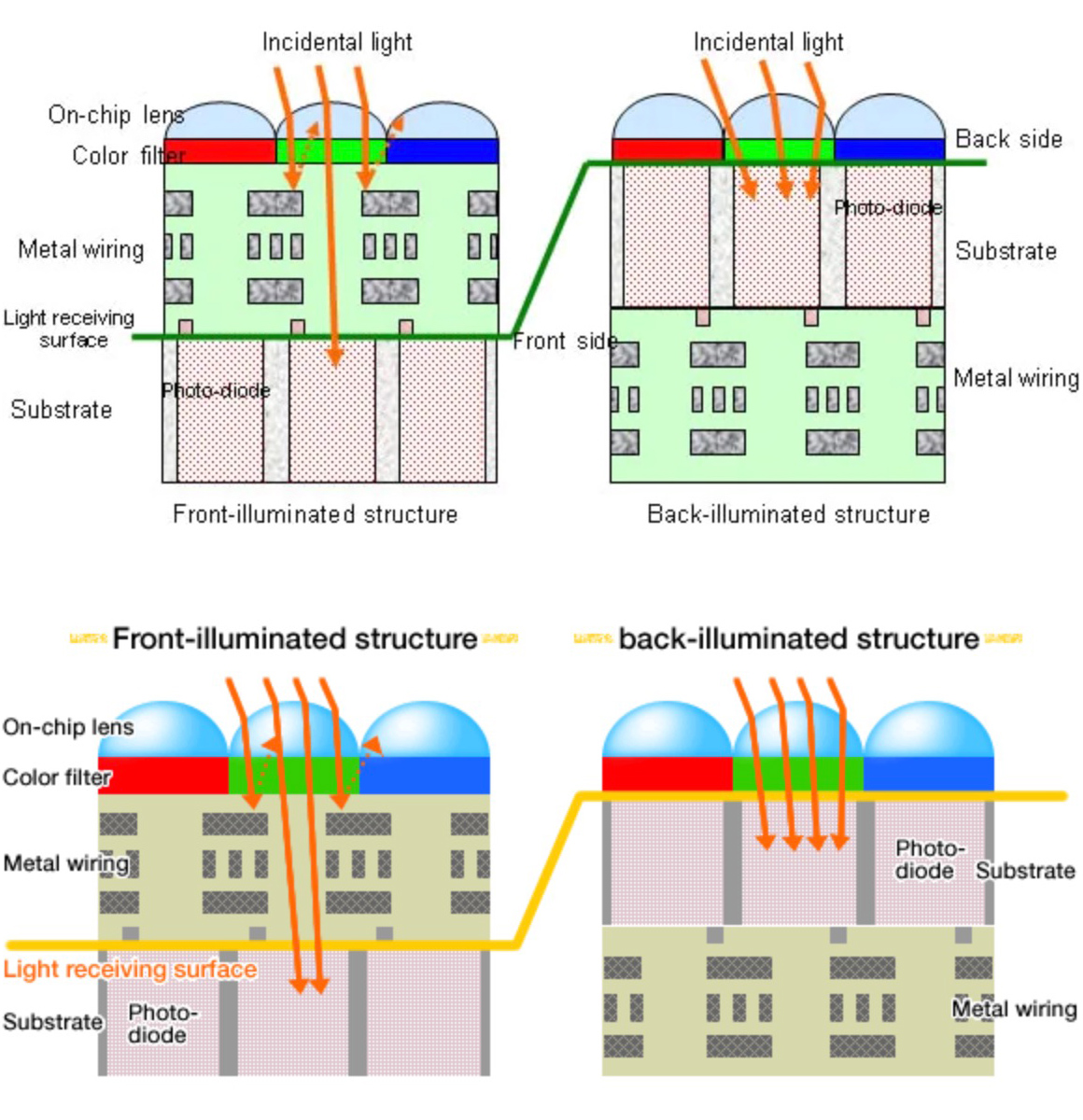

Nous l’avons vu, un capteur photo est constitué de diverses couches et de pistes électriques. Celles-ci peuvent se situer à deux endroits différents : soit devant les photosites (les photons doivent traverser les circuits électriques avant de tomber au fond du puit de lumière), soit derrière (le circuit électrique se trouve tout en bas du capteur, donc n’interfère pas avec le parcours des photons). Dans le premier cas, on parle de capteur FSI CMOS (FrontSide Illuminated) et dans le second de BSI CMOS (BackSide Illimunated). La quasi-totalité des capteurs de smartphones sont de type BSI CMOS depuis l’iPhone 4s. Du côté des appareils photo numériques, les BSI CMOS demeurent l’apanage des modèles hybrides et reflex haut de gamme, ce qui leur permet de monter plus haut en sensibilité sans bruiter.

Source : Sony

Les FSI CMOS restent cependant majoritaires, car, proportionnellement à la taille des capteurs photo, la surface occupée par les pistes électriques demeure acceptable et le coût supplémentaire d’un BSI CMOS ne justifie pas forcément le gain qualitatif. Par défaut, si la fiche mentionne uniquement « CMOS », il est sous-entendu qu’il est de type FSI.

La taille, la définition et la résolution : le triangle magique

Maintenant que vous avez décidé quelle technologie de capteur adopter (même si, dans les faits, vous n’avez pas vraiment le choix), reste à déterminer quelle taille et quelle définition correspond le mieux à vos besoins. Ceci est d’autant plus vrai sur un appareil photo numérique, puisque ce choix aura un impact direct sur le boîtier, les objectifs, l’écosystème d’accessoires et même le type d’images que vous pourrez faire.

La taille, un débat vieux comme la photographie

Si vous pensez que la taille du capteur d’un appareil photo est un problème propre à la photographie numérique, détrompez-vous ! Au temps de l’argentique, c’était encore pire. À partir des deux types de films les plus communs (le format 120 et le format 135, mais il en a existé bien d’autres), il était possible d’obtenir des images de surfaces et ratios différents. Les films 120 étaient utilisés (et le sont toujours) sur les appareils dits « moyen format ». En fonction de l’appareil dans lequel ce film est chargé, vous pouvez obtenir des images de 6 x 6 cm (format carré popularisé par les Hasselblad et les Rolleiflex), de 4,5 x 6 cm, de 6 x 7 cm (comme dans les Pentax 67), de 6 x 9 cm, de 6 x 12 cm et même de 6 x 17 cm (format panoramique très laaaaaarge) !

Le 24 x 36 mm sert aujourd’hui encore de référence en numérique

Il en va de même avec les films 135 utilisés dans les appareils dits « petit format ». En fonction de l’appareil, vous pouviez obtenir des images carrées de 24 x 24 mm, des rectangulaires horizontales de 24 x 32 mm (ratio 4:3), de 24 x 34 mm (comme dans les tout premiers appareils Nikon), monter jusqu’à du 24 x 65 mm (comme sur l’Hasselblad XPan) et même des « demi-images » verticales de 18 x 24 mm. Mais un format en particulier se démarquera et aura une influence sans commune mesure dans l’histoire de la photographie : le 24 x 36 mm, popularisé (mais pas inventé) par Leitz et son mythique Leica. Et c’est bien ce 24 x 36 mm qui sert aujourd’hui encore de référence en numérique.

Héritage de l’argentique, le « 24 x 36 mm » est celui à partir duquel tout est calculé et évalué. Les anglophones l’appellent « Full Format », un peu trop littéralement traduit par « Plein Format », et ne doit pas être confondu avec un autre FF, qui lui est l’acronyme de « Full Frame ». Dans ce dernier cas, un capteur photo « Full Frame » est un capteur dont 100 % de la surface disponible est dédiée à la captation de lumière, ce qui est incompatible avec l’architecture des CMOS. Ainsi, un capteur CMOS de 24 x 36 mm de dimension est Full Format, mais pas Full Frame, alors qu’un capteur CCD plus petit peut être Full Frame, mais n’est pas considéré comme Full Format.

En vous baladant dans les allées d’un « Big Camera » au Japon vous tomberez régulièrement sur ce genre de présentoir, avec de vrais capteurs de différentes tailles. Remarquez la petite pirouette marketing consistant à prendre l’APS-C comme référence (100 %) pour accentuer le gain en passant au 24 x 36 mm (236 %, rien que ça)…

La taille du capteur photo a un impact direct sur les focales perçues, mais le terme « focale équivalente » est utilisé. La formulation complète devrait être « focale équivalente à un objectif de même focale monté sur un capteur 24 x 36 mm », mais ce serait évidemment trop long à écrire à chaque fois. En utilisant un appareil photo doté d’un capteur plus petit que le 24 x 36 mm (et a fortiori un smartphone), il faut donc tenir compte du facteur de conversion (ou « crop factor ») par lequel multiplier la focale réelle pour obtenir la focale équivalente, ou au contraire par lequel diviser la focale équivalente (généralement celle donnée par les fiches techniques des smartphones). Ce facteur de conversion est facile à calculer, puisqu’il s’agit de la division de la diagonale d’un capteur 24 x 36 mm (environ 43,27 mm) par la diagonale du capteur considéré. Mais comme il serait rébarbatif de procéder au calcul à chaque fois, autant retenir par cœur ce tableau fournissant les informations pour les tailles de capteur que vous retrouvez usuellement sur les APN :

| Nom usuel de la taille de capteur : | Exemples d'APN utilisant cette taille de capteur : | Hauteur : | Largeur : | Diagonale : | Facteur de conversion : | Focale équivalente obtenue en montant un objectif de 50 mm : | Objectif devant être utilisé pour obtenir un équivalent 50 mm : |

|---|---|---|---|---|---|---|---|

| 24 x 36 mm | Nikon Z6 II, Sony Alpha 7, Canon EOS 5D, Panasonic Lumix S5, Leica M10, Pentax K-1 | 24 mm | 36 mm | 43,27 mm | 1 x | 50 mm | 50 mm |

| APS-C | Nikon D500, Sony Alpha 6500, Fujifilm X-T4, Fujifilm X100V | 16 mm | 24 mm | 28,84 mm | 1,5 x | 75 mm | ≈ 35 mm (éq. 52,5 mm) |

| APS-C (dans le cas des APN Canon seulement) | Canon EOS 850D, Canon EOS-M50 Mk II, Canon PowerShot G1X Mk III | 14,7 mm | 22,2 mm | 26,63 mm | 1,6 x | 80 mm | ≈ 30 mm (éq. 48 mm) |

| 4/3'' | Tous les hybrides Micro 4/3 chez Olympus (OM-D et Pen) et Panasonic Lumix G (GH5, GX9, G80, etc) | 13 mm | 17,3 mm | 21,64 mm | 2 x | 100 mm | 25 mm (éq. 50 mm) |

| Type 1'' | Sony RX100 (toute la série), Canon PowerShot G7X II, Panasonic Lumix TZ200, Panasonic Lumix CM1 | 8,8 mm | 13,2 mm | 15,86 mm | 2,7 x | 135 mm | ≈ 18 mm (éq. 48,6 mm) |

Et les smartphones ? La logique est strictement la même, mais comme chaque constructeur et sous-traitant y va de sa petite botte plus ou moins secrète, ce ne serait plus une fourchette de taille, mais un râteau qu’il faudrait donner. Voici néanmoins quelques dimensions que vous retrouverez fréquemment chez les uns et les autres :

| Nom usuel de la taille de capteur : | Exemples de smartphones utilisant cette taille de capteur : | Hauteur : | Largeur : | Diagonale : | Facteur de conversion : | Focale équivalente obtenue en montant un objectif de 50 mm : | Objectif devant être utilisé pour obtenir un équivalent 50 mm : |

|---|---|---|---|---|---|---|---|

| Type 1/1,12" | Xiaomi Mi 11 Ultra | 8 mm | 10,3 mm | 13,34 mm | 3,2 x | 160 mm | ≈ 16 mm (éq. 51,2 mm) |

| Type 1/1,33'' | Samsung Galaxy S20 Ultra | 7,2 mm | 9,6 mm | 12 mm | 3,6 x | 180 mm | ≈ 14 mm (éq. 50,4 mm) |

| Type 1/1,7" | Huawei P30 Pro | 5,7 mm | 7,6 mm | 9,5 mm | 4,5 x | 225 mm | ≈ 11 mm (éq. 49,5 mm) |

| Type 1/2" | One Plus 7 Pro | 4,8 mm | 6,4 mm | 8 mm | 5,4 x | 270 mm | ≈ 9 mm (éq. 48,6 mm) |

| Type 1/2,33" | DJI Mavic 2 Pro | 4,5 mm | 6,2 mm | 7,66 mm | 5,6 x | 280 mm | ≈ 9 mm (éq. 50,4 mm) |

Définition et résolution : indissociables, mais faux-amis

Les deux sont souvent confondus et, même s’ils sont intimement liés, l’un ne doit pas être utilisé pour l’autre. La confusion vient du fait qu’en anglais le terme « resolution » signifie « définition ». Pour la résolution, les anglophones préfèreront parler de « pixel density ». Retenez surtout que :

- La définition d’un capteur correspond au nombre de photosites présents sur ce capteur. Elle est exprimée en pixels (px), mégapixels (1 Mpx = 1 000 000 px) voire gigapixels (1 Gpx = 1 000 000 000 px).

- La résolution d’un capteur correspond à la définition rapportée à la taille du capteur. Elle devrait normalement être exprimée en pixels/cm², mais, par commodité, il est souvent question de pixels par pouce (« pixel per inch » ou ppi ), qui est une densité linéaire exprimée dans une unité impériale.

En d’autres termes, la définition est toujours une population et la résolution est une densité de population rapportée à une surface donnée. Ainsi, à taille de capteur égale, plus la définition est élevée, plus la résolution est élevée. Par contre, à définition égale, un capteur photo plus grand aura une résolution plus faible que le capteur plus petit. La résolution seule, quant à elle, ne vous dira rien de la taille ni de la définition du capteur.

PS5 - un nouveau modèle serait prévu pour 2022, sans changement esthétique

06/05/2021 12:45 PM

Quels sont les meilleurs smartphones à acheter en 2021

06/05/2021 10:35 AM

La Hyundai Ioniq 5 affiche un prix d’entrée agressif à moins de 40 000 euros

06/05/2021 09:58 AM

TV 4K QLED - ce modèle TCL de 50 pouces ne dépasse plus les 500 euros

06/05/2021 12:15 PM

Samsung - des puces plus rapides grâce à une conception inspirée d’Intel

06/05/2021 10:30 AM

Smartphones OnePlus - bien comprendre la gamme pour mieux choisir

06/05/2021 07:00 PM

- Racing

- Sports Games

- Comics

- Cards & Casino

- Media & Video

- HEALTH

- Libraries & Demo

- Arcade & Action

- Photography

- Transportation

- Weather

- Social

- Casual

- Brain & Puzzle

- Productivity

- Communication

- Finance

- Medical

- Health & Fitness

- Personalization

- Shopping

- Tools

- Sports

- Entertainment

- Business

- Music & Audio

- News & Magazines

- Books & Reference

- Education

- Lifestyle

- Travel & Local

2014 © Applications françaises